- Avant propos

- Introduction à la synthèse musicale

- Le son de la VAE

- Synthèse sonore: Concepts généraux et création du Lead

- Synthèse sonore: Saturation

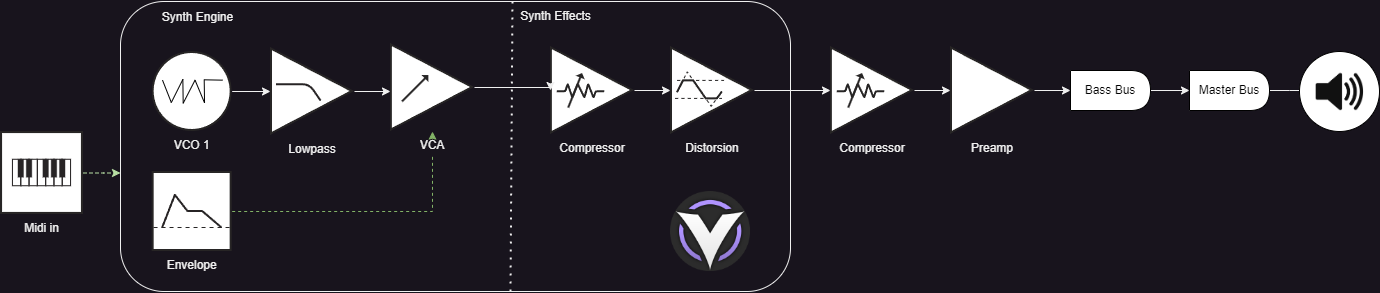

- Synthèse sonore: Basse

- Synthèse sonore: Pad

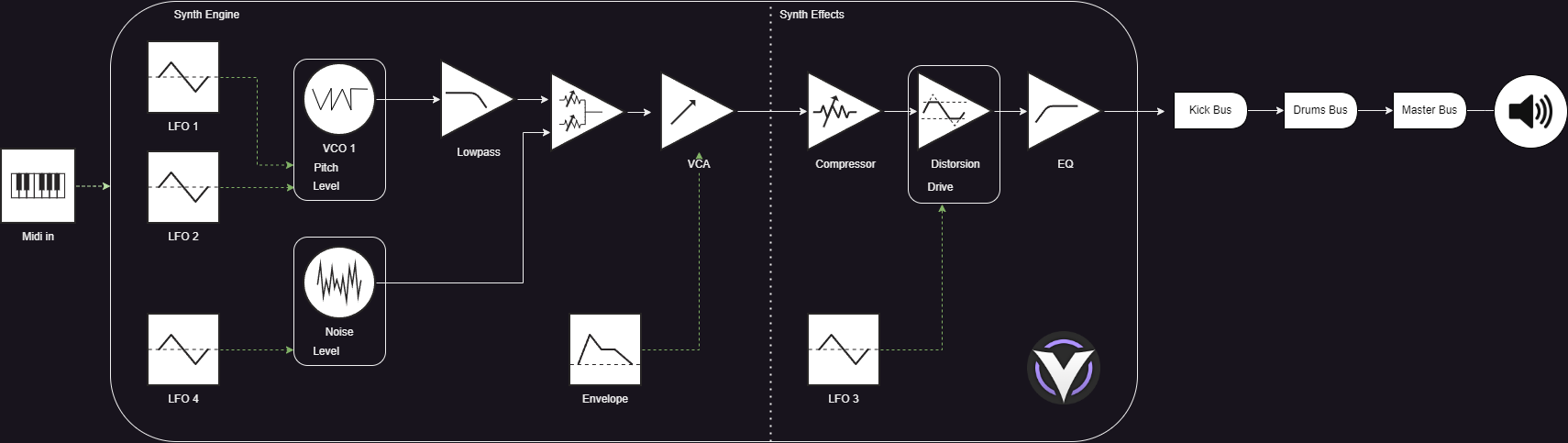

- Synthèse sonore: Kick

- Synthèse sonore: Toms

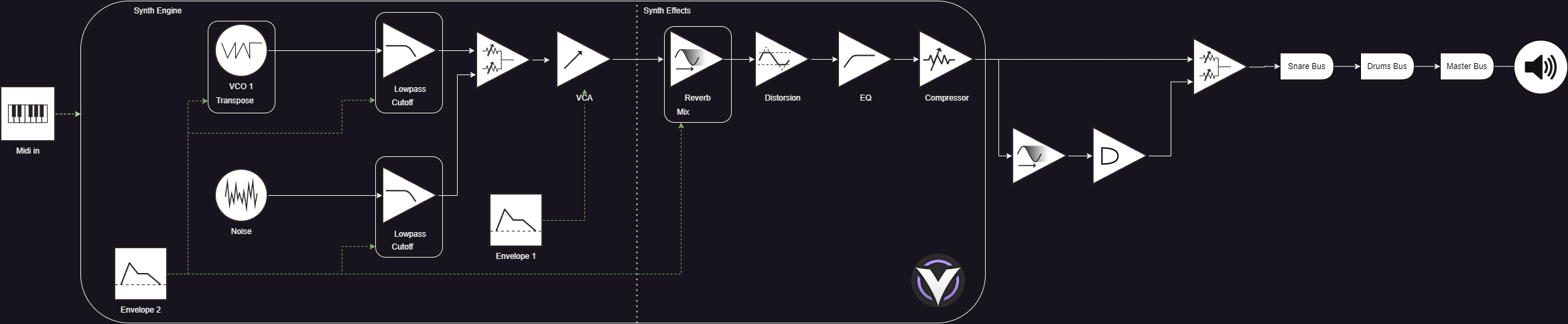

- Synthèse sonore: Snare & Clap

- Synthèse sonore: Hi Hat

- Arrangements, mixage et mastering

- Rendu final

- Credits

Avant propos

Cette page a pour but d’enrichir les annexes de ma VAE. J’évoquais, parmi mes hobbys, la musique. Hors, certains aspects de la production musicale et des connaissances acquises lors de mes études en GE se recouvrent.

Cette page a pour vocation de mettre certains de ces aspects en évidence et de les illustrer. Elle n’est en aucun cas exhaustive.

Introduction à la synthèse musicale

La synthèse sonore est un ensemble de techniques permettant la génération de signaux sonores.

Wikipedia – Synthèse sonore

En musique, elle permet de produire des sons intéressants ou agréables à l’oreille. Cela peut se faire en essayant de reproduire des instruments de musique existants, mais aussi en inventant de nouvelles sonorités électroniques. L’exemple le plus évident est le synthétiseur, dont l’histoire est fortement corrélée avec celle de la synthèse sonore.

Il existe une infinité de synthétiseurs et plusieurs approches à la synthèse musicale. L’approche la plus commune est de générer un signal “basique” (carré, sinus, triangle ou dent de scie) de fréquence audible (20Hz – 20 000Hz) et de le multiplier avec d’autres signaux (synthèse additive) ou de le filtrer (synthèse soustractive).

D’autres approches sont possibles comme la modulation de fréquence, les tables d’ondes, la synthèse granulaire… etc. Cette annexe n’ayant pas pour but d’être exhaustive, vous pouvez vous référer au lien Wikipédia ci-dessus pour plus d’information.

Pour cet exemple, je vais utiliser le synthétiseur digital “Vital” qui est gratuit et tourne sous Windows. C’est un synthétiseur à table d’ondes avec lequel je ne synthétiserais qu’un signal (tableau à une entrée) pour faire de la synthèse additive et soustractive.

Vital est téléchargeable à cette adresse: https://vital.audio/

Le son de la VAE

Pour illustrer mon propos, je vais créer un signal que nous allons analyser et avec lequel je vais composer – et quoi de mieux pour illustrer cette VAE que de synthétiser un signal reprenant la forme des 3 lettres de ma validation des acquis d’expérience : le V, le A et le E.

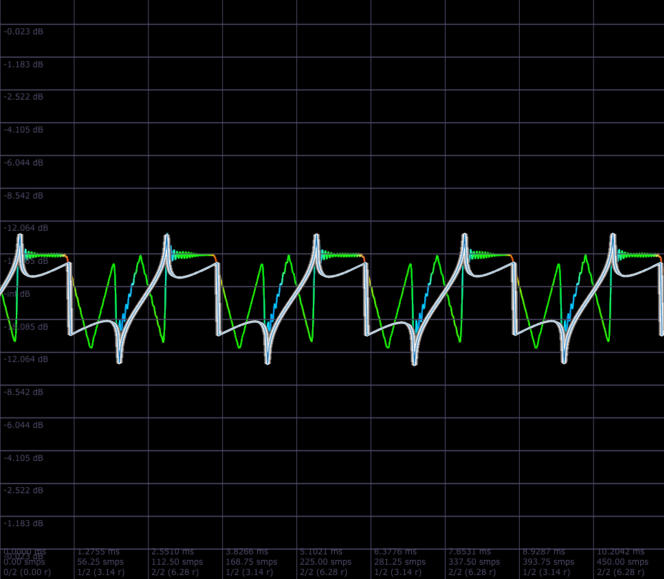

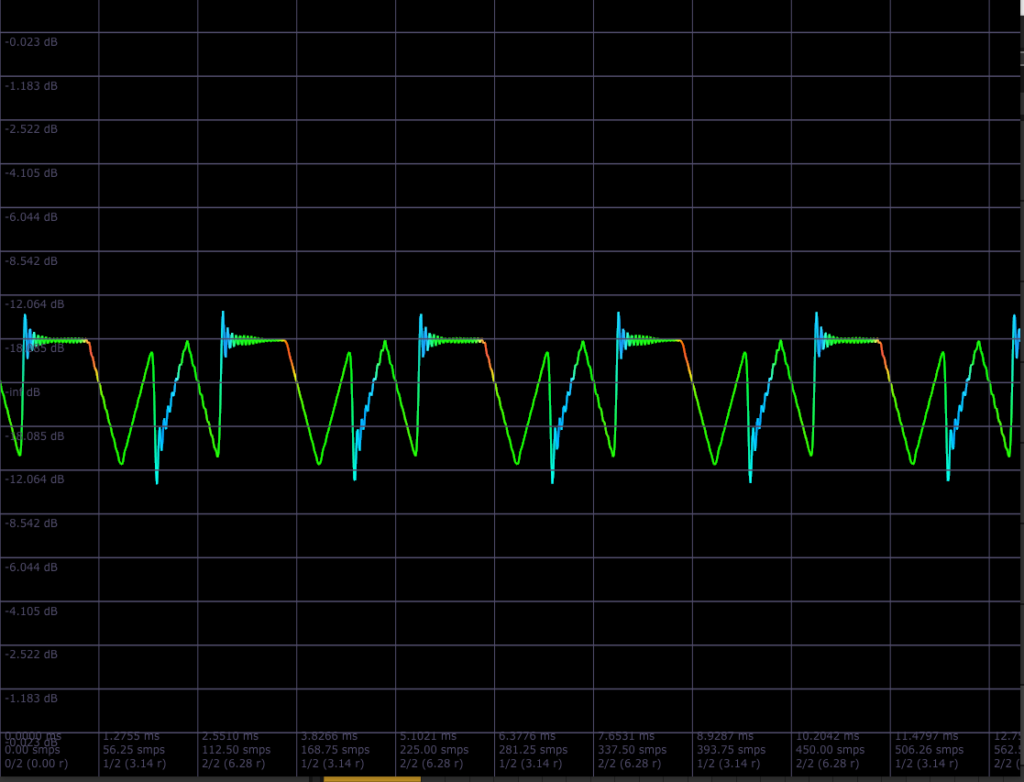

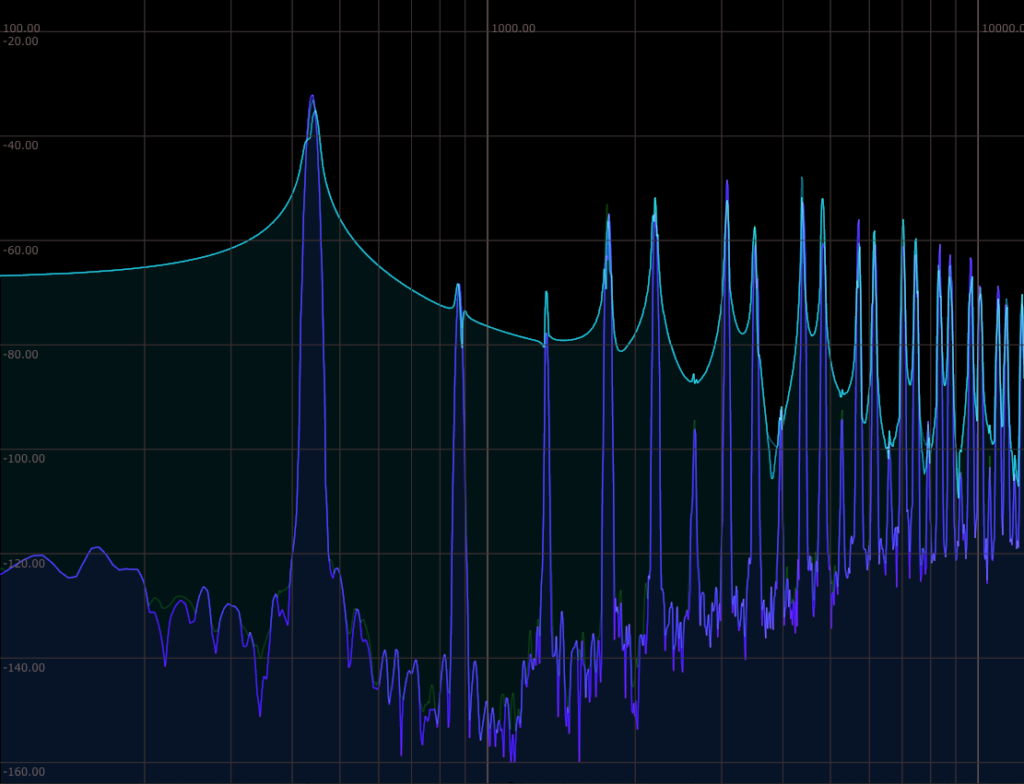

Nous sommes ici en présence d’un signal cyclique alternant 2 dents de scie inversées, un triangle et un carré. Regarder le signal à l’oscilloscope permet de “confirmer” que l’oscillateur du synthétiseur est additif : La plupart des synthétiseur additifs, notamment les synthétiseurs digitaux, ne synthétisent pas d’harmoniques passé la fréquence audible de 20 kHz. Les “pics” et le “crénelage” visibles sont en partie dus aux harmoniques manquantes passées 20 kHz.

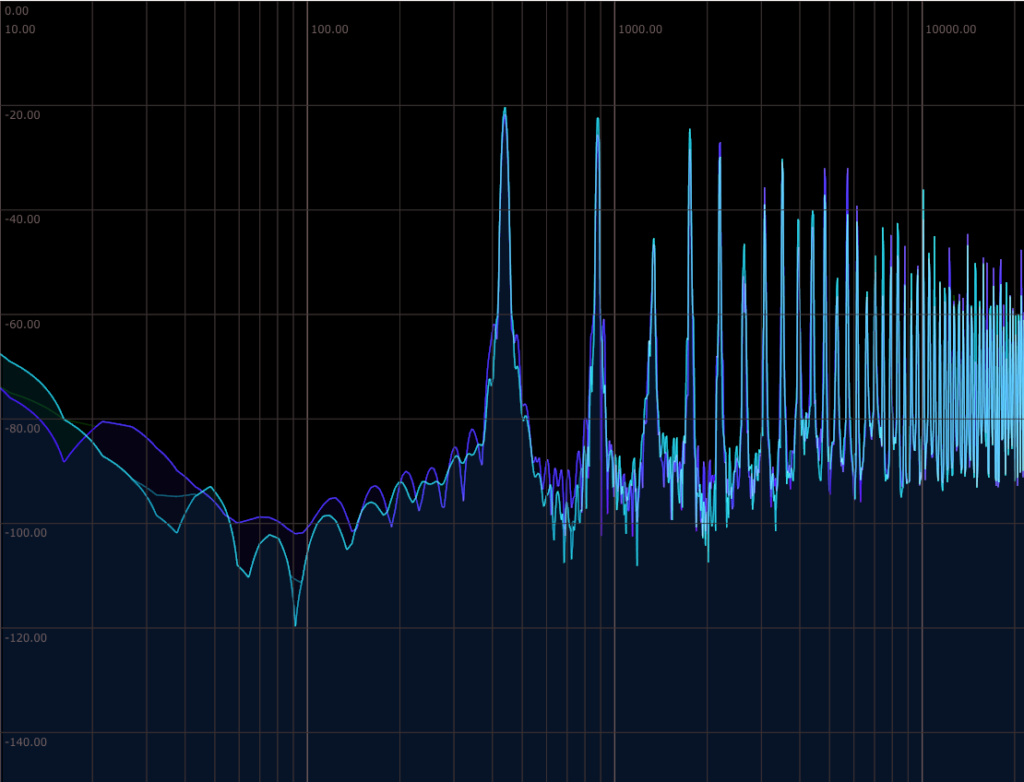

Ceci devient encore plus flagrant en analysant le signal au spectroscope. On observe un signal riche en harmonique, comportant aussi bien des harmoniques paires qu’impaires. La décomposition du signal en série de fourrier ressemble à un signal en dent de scie dont toutes les harmoniques multiples de 3 auraient été fortement atténuées :

Par curiosité j’ai tenté de supprimer toutes les 3 valeurs de la série de Fourier d’un signal en dent de scie. Le signal résultant, bien que différent se comporte de manière similaire au signal “VAE”.

Ci-dessous le script Python utilisé pour générer le signal:

import numpy as np

from scipy import signal

import matplotlib.pyplot as plt

t = np.linspace(0, 1, 500)

n = np.fft.fft(signal.sawtooth(2 * np.pi * 5 * t))

N=3

for idx, ele in enumerate(n):

if idx % N == 1 and idx != 0:

n[idx] = 0

s = np.fft.ifft(n)

plt.plot(t, s)

plt.show()

Nous allons pour la suite prendre le signal “VAE” comme oscillateur pour créer différents instruments.

Synthèse sonore: Concepts généraux et création du Lead

Pour le son de “lead” (le synthétiseur principal en charge de la mélodie) je souhaitais autant que possible garder le “timbre” du signal de VAE, tout en l’enrichissant et en lui donnant du dynamisme.

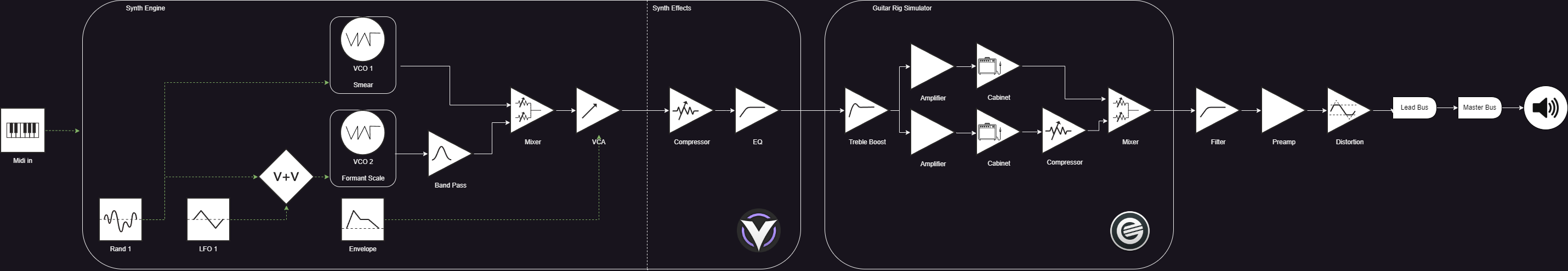

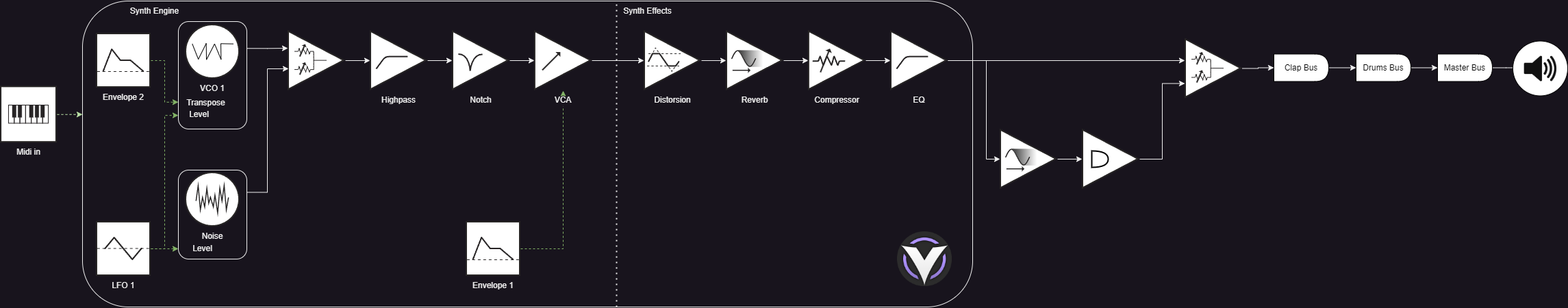

Le schéma ci-dessus reprend de manière synthétique le traitement subi par le signal. Les flèches blanches représentent le signal sonore et les flèches vertes un signal de contrôle.

Dans les grandes lignes, le synthétiseur récupère des informations au format midi. Deux oscillateurs (VCO) génèrent le signal “VAE” à l’unisson.

VCO 1 dispose d’un modificateur de spectre contrôlé par un oscillateur basse fréquence (LFO) synchronisé avec les informations de tempo reçues depuis le bus MIDI.

VCO 2 génère le signal “VAE” brut, avant de passer dans un filtre passe bande qui atténue légèrement les hautes et les basses fréquences. Si j’ai besoin d’enrichir le son plus tard je pourrais au besoin rajouter un 3eme oscillateur en parallèle de VCO 2 qui génèrerait le son à l’octave supérieur (doublement de la fréquence fondamentale).

Le signal filtré et le signal modulé sont ensuite additionnés et “sculptés” en passant par un amplificateur contrôlé par une enveloppe (VCA).

Le synthétiseur virtuel Vital a la particularité d’aussi contenir plusieurs effets. J’ai rajouté plusieurs de ces effets pour continuer à former le signal pour qu’il soit riche à l’oreille. Ces opérations se situent souvent hors synthétiseur dans des modules externes. Le signal ainsi généré sera traité dans le bloc “lead bus”. Tous les “bus” des instruments sont renvoyés vers le même “master bus” avant d’être audibles.

Dans le cadre de l’ingénierie du son, on peut simplifier le cheminement du signal en 4 grand blocs : le signal, les effets, le bus de mixage et celui de mastering. Prenons l’exemple d’une guitare électrique. La vibration des cordes est “transformée” en signal électrique via les micros placés sur le corps de la guitare. Le son d’une guitare électrique peut varier selon l’articulation du jeu du guitariste, le matériau de corps et du manche, le positionnement des micros, leur qualité… etc. Le signal “brut” qui sort du corps de la guitare électrique via le câble jack équivaut à la partie “signal” susmentionnée et à la partie “synth engine” de mon diagramme.

Le son ainsi crée est souvent envoyé vers un amplificateur et/ou des pédales d’effet avant d’être enregistré. Cette partie “effets” correspond a à la partie “Synth effects” de mon schéma. Elle est intégrée au synthétiseur dans le cas du lead, mais pourra aussi être réalisée via des modules externes.

La partie “instrument bus” et “master bus” de mon schéma correspondent respectivement au mixage et au master. Le mixage a pour but de resculpter / réadapter le son d’une piste dans le contexte d’une composition musicale. Le master a pour but d’adapter le signal “complet” de toutes les pistes au medium sur lequel il sera écouté. Ces aspects seront évoqués supperficiellement à la fin de cette annexe.

Ce “preset” ainsi que tous les autres présentés en dessous sont téléchargeables à cette adresse: https://florianabry.me/files/VAE_Vital_Presets.vitalbank

Synthèse sonore: Saturation

La lead saturée est similaire dans sa construction au son de la lead créée dans le paragraphe précédent. Un signal aléatoire a été ajouté au signal de contrôle LFO 1 pour un rendu plus “organique”.

Le signal des oscillateurs a été légèrement modifié pour avoir plus d’harmoniques et un son plus saturé. Cette saturation est amplifiée par un module de simulation d’amplis de guitares électriques.

Pour ajouter de la dynamique le signal a été “haché” par un filtre modulé par un signal en dent de scie (voir le screenshot ci-contre). J’ai aussi rajouté un préampli et un module simulé de distorsion à tube pour finir de sculpter le son et avoir un rendu “agréable”.

Synthèse sonore: Basse

La synthèse du son de basse est particulièrement simple. Je souhaitais un signal qui “supporte” les autres instruments dans les basses fréquences avec très peu d’harmoniques. J’ai fait de la synthèse soustractive en filtrant mon signal “VAE” avec un filtre passe bas pour arriver à un signal proche d’un sinus.

Le signal a ensuite été enrichi de quelques autres harmoniques via une légère saturation et un préampli simulé. Le signal reste “pauvre” avec -60dB d’amplitude dès la 6ème harmonique.

Synthèse sonore: Pad

Le pad a pour but d’ajouter de la texture au son. C’est un élément que l’on retrouve au “second plan”. Il se doit d’être dynamique, d’où l’ajout de contrôles générés aléatoirement.

La LFO contrôle la fréquence de coupure d’un filtre en peigne. L’effet obtenu rappelle celui d’un déphaseur, ajoutant du mouvement au son.

L’enveloppe a une attaque et un “decay” important pour renforcer l’impression de nappe “en fond”. Le delay et la reverb ont été configurés dans ce sens. Le chorus permet quant à lui d’avoir un son plus ample dans le champ stéréo.

Du point de vue de la décomposition du signal en fréquence, on remarque que les 2ème et 3ème harmoniques ont une amplitude assez faible. Cela va jouer en notre faveur au moment de l’arrangement : les autres éléments mélodiques ont une forte amplitude sur les premières harmoniques qui décroit ensuite rapidement. Ici, cette augmentation de l’amplitude autour de la 7ème, 8ème, 10ème et 11ème harmoniques devrait permettre à chaque son de cohabiter dans le spectre sonore sans trop se confondre.

Synthèse sonore: Kick

Le Kick est le premier élément percussif créé. Les éléments percussifs ne contiennent que peu d’informations de tonalité et sont surtout composés de bruit. Le Kick (grosse caisse) ne fait pas exception.

Un Kick peu généralement être décomposé en un signal sinusoïdal de basse fréquence couplé à du bruit blanc ou du bruit brun (le bruit blanc contient toutes les fréquences audibles à même volume alors que le bruit brun suit la répartition en fréquence de la courbe isosonique, voir le paragraphe “Arrangements, mixage et mastering”). J’ai donc du adjoindre à mon oscillateur “VAE” un générateur de bruit. Pour la sinusoïde, j’ai simplement filtré le signal VAE avec un filtre passe bas pour ne garder que la fondamentale.

Une autre particularité de mes éléments percussifs est l’ajout, de ma part, d’un bus entre celui du signal et le master. Sur le schéma ci-dessus, le “Kick Bus” va d’abord dans un “Drum Bus” avant de rejoindre le “Master Bus” (voir le schéma ci-contre). Cela n’a aucune importance au niveau du sound design mais sera important pour le mixage. Les éléments percussifs ayant des pics d’intensité élevés (“transient”), il est important de pouvoir traiter ces éléments ensemble avant de les envoyer sur le master. J’y reviendrais plus en détail dans le dernier paragraphe.

Synthèse sonore: Toms

Pour des raisons de temps, je me suis inspiré du preset “Old Tom” créé par “Level 8” pour arranger ce patch.

Même si fondamentalement le tom est construit comme un élément percussif (une sinusoïde plus du bruit), ce dernier contient plus d’informations de tonalité que le kick. L’oscillateur (VCO 1) y est plus audible et le filtre passe bas laisse encore passer beaucoup d’harmoniques.

La tonalité du signal VAE, et des éléments mélodiques dans leur ensemble, est très synthétique. La “couleur musicale” peut rappeler les sons sythétiques des années 80 ou leur récent revival. J’ai voulu m’inspirer de cette esthétique pour mes toms en utilisant une technique de sound design en vogue à l’époque, nommée “gated reverb”.

Comme son nom l’indique, il s’agit d’ajouter une “gate” à une “reverb”. Dans mon cas, le signal des toms synthétisé est envoyé sur le “toms bus”. En parallèle le signal est envoyé dans une reverb (ici un EMT 140 simulé pour un rendu encore plus vintage). Le son de la reverb est connecté à une “gate”. Dans mon cas, la gate ne laisse passer que les signaux de plus de -30dB. La reverb n’a pas le temps de “finir” ses réverbérations et se retrouve “abruptement” coupée. Cette technique, principalement utilisée sur les toms et les caisses claires (snare) est devenu iconique sur certains hits des années 80 tels que “In The Air” de Phil Collins, “Money For Nothing” de Dire Straits ou “Hounds of love” de Kate Bush pour ne citer qu’eux.

Synthèse sonore: Snare & Clap

L’approche pour la snare (caisse claire) et pour les claps est la même que discutée précédemment. La “reverb” utilisée diffère, tout comme le niveau de passage de la “gate” mais il n’y a que peu de nécessité de revenir sur ces éléments.

Synthèse sonore: Hi Hat

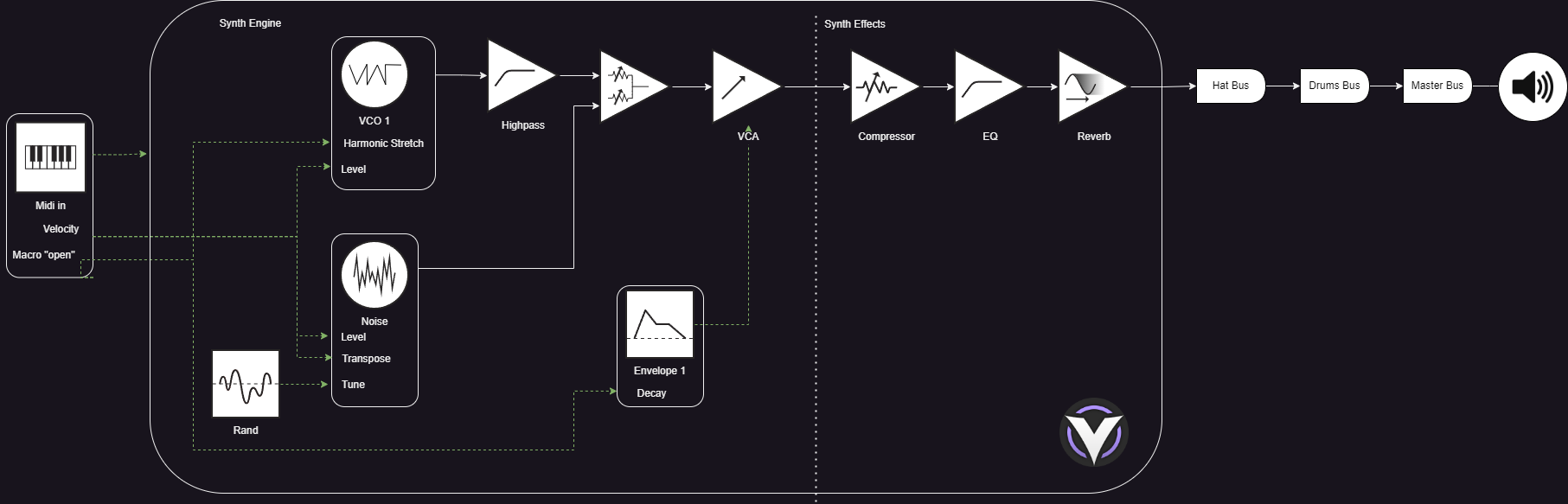

La synthèse du Hi-Hat (charleston) est assez simple. Le son de cet instrument se rapproche de celui du bruit blanc. Le VCO1 est avant tout cosmétique et n’apporte que quelques harmoniques dans les hautes fréquences (> 3kHz).

La particularité de ce patch vient du fait que, contrairement aux précédents, la modulation ne vient presque pas de signaux de contrôles générés au sein du synthétiseur, mais de signaux “externes” transmis par le bus midi. Cela vient du fait, que plus que les autres instruments, le hi-hat a plusieurs facettes. Le son en lui-même (du bruit blanc) est assez “désagréable”. Son intérêt vient des possibilités d’articulation que l’instrument permet : L’instrument sonne et résonne différemment selon qu’il soit ouvert ou fermé, selon que le batteur tape son centre ou ses bord et selon l’intensité de l’impact des baguettes. C’est en parti ce que j’ai voulu recréer avec la modulation “externe”.

Le protocole midi contient de base, en plus du son de la note, une information d’intensité nommée “velocity”. Sur un clavier midi, cette information correspond à la force avec laquelle la touche a été appuyée. La “velocity” est lisible depuis Vital. Plus un batteur tape fort sur une hi-hat, plus le son est fort et plus il apparait aigu. En influençant le “level” de mes deux oscillateurs, j’augmente le volume. “Transpose” augmente la vitesse de restitution du signal de bruit, donnant l’impression qu’il est plus “aigu”.

J’ai par ailleurs rajouté une macro pilotable depuis le bus midi qui influe sur le “decay” de l’enveloppe contrôlant le VCA. Ainsi, le son raisonne plus longtemps, de manière similaire à un hi-hat ouvert. Le tout permet de créer des “grooves” comme celui écoutable en exemple ci-dessus.

Maintenant que tous les instruments sont créés, je les ai assemblés de manière à illustrer cette annexe avec un morceau de musique.

Arrangements, mixage et mastering

Le rendu final “brut” est écoutable ci-dessus. Cet extrait sans prétention est avant tout là pour utiliser les sons synthétisés précédemment dans un contexte musical. Comme mentionné plus haut, les différents templates Vital utilisés sont téléchargeables à l’adresse suivante : https://florianabry.me/files/VAE_Vital_Presets.vitalbank

Le morceau n’a pas encore été proprement arrangé, mixé et masterisé. Détailler cette étape serait trop long dans le contexte d’une “simple annexe”. Je vais cependant en mentionner quelques éléments.

Le mixage à deux fonctions principales : arranger les éléments de manière à rendre le morceau de musique plus intéressant (voir parfois rajouter des effets ou des éléments discrets) et équilibrer le morceau pour qu’il soit agréable à l’écoute.

Ce dernier élément est le plus intéressant pour cette annexe. L’oreille humaine ne perçoit pas toutes les fréquences de la même manière. Les basses fréquences sont perçues plus faiblement que les hautes. Si on se réfère à la courbe isosonique ci-contre, un signal de 20Hz de 90dB sera perçue comme étant au même “volume” qu’un signal de 1kHz à 50dB. L’atténuation entre ces deux fréquences est dans ce cas de 40dB.

Le mixage doit notamment prendre cela en compte dans la gestion du volume des différents éléments. Les instruments jouant dans un registre grave doivent être mixés plus en avant (plus fort) pour être audibles. L’utilisation extensive des filtres, de la saturation et de la compression peut aussi permettre de faire “ressortir” les harmoniques d’instruments jouants dans un registre grave pour donner des “points d’accroches” à l’oreille humaine.

Il est par ailleurs important de filtrer les basses fréquences des instruments évoluant dans un registre plus haut. L’oreille humaine percevant mal les fréquences les plus basses, elle a aussi des difficultés à les différencier. Trop de signaux différents dans les fréquences de moins de 100Hz rendent le signal inintelligible pour notre oreille. Les deux éléments principaux évoluant dans ce registre sont le kick et la basse. Pour “arbitrer” entre ces deux signaux, j’utilise un compresseur avec une “sidechain”.

Typiquement, un compresseur réduit le gain d’un signal quand celui-ci dépasse un seuil donné. Les compresseurs audios agissent généralement sur différentes bandes de fréquences, réduisant le gain de la bande de plus haute intensité mais conservant celui des autres. Dans le cas d’une “sidechain”, la compression est effectuée quand un autre signal dépasse ce seuil. Dans notre cas, je “compresse” les fréquences de moins de 500Hz de ma basse quand mon kick dépasse les -30dB. J’évite ainsi que les deux signaux ne se parasitent l’un-l’autre.

Le point essentiel du mixage est de donner une place aux instruments dans le contexte du morceau. Le kick fait office de fondation rythmique et se doit d’être présent. C’est pour cette raison que c’est lui qui compresse la basse et non l’inverse. Il se doit aussi de ressortir face aux autres éléments sans pour autant les éclipser. Pour ce faire, j’ai décidé d’utiliser un filtre que l’on pourrait simplifier comme étant un “coupe bande” autour de 1kHz (voir ci-contre). Ainsi, j’augmente les fréquences < 100Hz, je réduis celles entre 100Hz et 3kHz où se situe la majorité de ma mélodie et j’amplifie les fréquences > 3kHz pour lui donner plus de présence.

Cette réflexion sur les bandes de fréquence et l’intensité des différents instruments est au cœur du mixage. Parmi les autre techniques “communes” il y a la compression du bus de batterie, déjà évoquée dans le paragraphe sur le kick. Le but de cette compression est de contenir le pic du signal audio des percussions quand elles sont jouées en même temps.

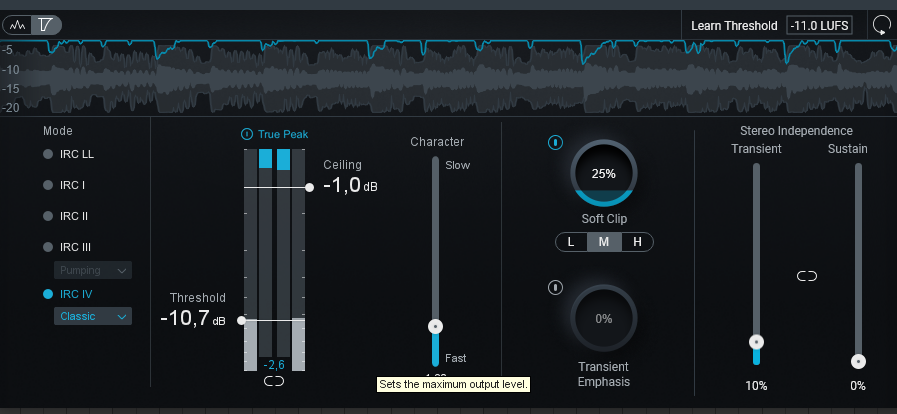

Une fois la phase de mixage finie, vient celle du mastering. On peut dire en simplifiant que plus on passe de temps sur le mixage, moins on en passe sur le mastering. Le but est ici de s’assurer que les différentes bandes de fréquences sont bien mixées une fois tous les instruments combinés. Il s’agit aussi de donner de la couleur au morceau final, la représentation en fréquence “idéale” d’un morceau de techno ou de country n’est pas la même. Il s’agit enfin de s’assurer que le volume et les pics sont adaptés au support sur lequel le morceau va être diffusé. En effet, différentes plateformes de streaming ont différents cahiers des charges, eux même différents d’un graveur de CD ou d’une presse à vinyle.

Dans le cas présent, j’ai limité mon master à onze LUFS, ce qui est par exemple la limite fixée par Soundcloud (le LUFS est l’unité de mesure de l’intensié audio percue. En simplifiant, on pourrait le définir comme le RMS qui aurait été pondéré par la courbe isosonique).

Rendu final

Voici le “son de la VAE” avec un minimum de mixage et un mastering simple. Cet extrait se veut un exemple du recoupage entre un de mes hobbies et certaines disciplines du GE. Merci d’avoir pris le temps de le lire.

Credits

- Diagrammes: Draw.io (JGraph Ltd, gratuit) – https://www.drawio.com

Interface gratuite de création de diagrammes. - Synthetizer: Vital (Vital, gratuit) – https://vital.audio

Le synthétizeur avec lequel tous les sons ont été synthétisés. Les patchs sont téléchargeables à l’adresse suivante: https://florianabry.me/files/VAE_Vital_Presets.vitalbank - Oscilloscope: Signalizer (Janus Lynggaard Thorborg, gratuit) – https://www.jthorborg.com/index.html?ipage=signalizer

Oscilloscope et spectroscope virtuels, utilisables sous forme de plugin (VST) pour analyser un signal audio. - Digital Audio Workstation: Ableton Live (Ableton, payant) – https://www.ableton.com/live/

Logiciel de création musicale. Utilisé ici pour créer le morceau, gérer les bus, connecter les plugins, mixer… etc - Effets: FX Collection (Arturia, payant) – https://www.arturia.com/products/software-effects/fx-collection/overview

Collection d’effets modellisés et simulés d’après du materiel existant. Le materiel simulé cité dans cette annexe vient de cette société grenobloise. - Ampli de guitare: Guitar Rig Player (Native Instruments, gratuit) – https://www.native-instruments.com/en/products/komplete/guitar/guitar-rig-6-player/

Simulateur d’ampli, de cabinet et de pédales d’effet virtuels. Utilisé pour le son saturé. - Python – https://www.python.org . Utilisation des bibliothèques suivantes:

- NumPy pour la gestion des tableaux et l’accès aux fonction de transformation de Fourrier et transformation inversée de Fourrier – https://numpy.org

- SciPy pour la génération de signal – https://scipy.org

- Matplotlib pour l’affichage du signal – https://matplotlib.org